Komut satırı yönteminden memnun değilseniz ve favori LLM’lerinize erişmek için bir GUI yöntemini tercih ediyorsanız bu makaleye göz atmanızı öneririm.

Ollama, kullanıcıların Meta Llama 3, Mistral, Gemma, Phi ve diğerleri gibi açık kaynaklı LLM’leri zahmetsizce indirmesine, çalıştırmasına ve erişmesine olanak tanıyan topluluk odaklı bir projedir (veya bir komut satırı aracıdır).

Model ağırlıklarını, yapılandırmalarını ve veri kümelerini bir Modelfile tarafından yönetilen tek bir pakette toplar, bu nedenle tek yapmanız gereken favori LLM’lerinizi indirip çalıştırmak ve komut satırı aracılığıyla sohbet arayüzüne erişmek için bir komut çalıştırmaktır.

Ayrıca kendi modelinizi oluşturabilir veya mevcut bir modeli özelleştirebilirsiniz, ancak bu biraz uzmanlık gerektirir ve genellikle normal kullanıcılar dahil olmaz, bu nedenle bu makalenin kapsamında değildir.

Bugünkü makalemde, popüler LLM’lere komut satırı aracılığıyla erişmek için Ollama’yı nasıl kuracağınızı ve kullanacağınızı göstereceğim. Ek olarak, ChatGPT’ye benzer bir web arayüzü elde etmek için Open WebUI’yi nasıl kullanacağınızı göstereceğim.

Ayrıca, bu makalede özetlenen yöntem, Raspberry Pi dahil olmak üzere Ubuntu, Debian, Fedora vb. gibi çeşitli Linux dağıtımlarıyla uyumludur.

Ollama Linux’a Nasıl Kurulur

Ollama’nın kurulumu ve ardından LLM sürecinin indirilmesi ve çalıştırılması basittir, ancak terminalinize atlamadan önce, LLM’lerle olan tüm etkileşimlerinizin yalnızca sisteminizin CPU’su veya GPU’su tarafından desteklenen yerel olarak (internet olmadan) gerçekleşeceğini bilin.

Bu nedenle, en az 16 GB RAM’e ve 4 GB Nvidia 1060 veya üzeri bir GPU’ya sahip olduğunuzdan emin olun; değilse, Intel i5 veya AMD Ryzen 3’ten daha büyük sekiz çekirdekli bir CPU. Bu notla başlayalım…

1. Adım: Ollama’yı Linux’a yükleyin

Resmi Ollama proje sayfası, kurulum için tek satırlık bir curl komutu sağlayarak Linux sisteminize hızlı ve kolay kurulum sağlar.

📝

Biraz büyücülük yoluyla fazladan bir can elde ederseniz, her şeyi ihtiyaçlarınıza göre özelleştirmenize olanak tanıyan manuel kurulum dikkate alınması gereken bir seçenektir.

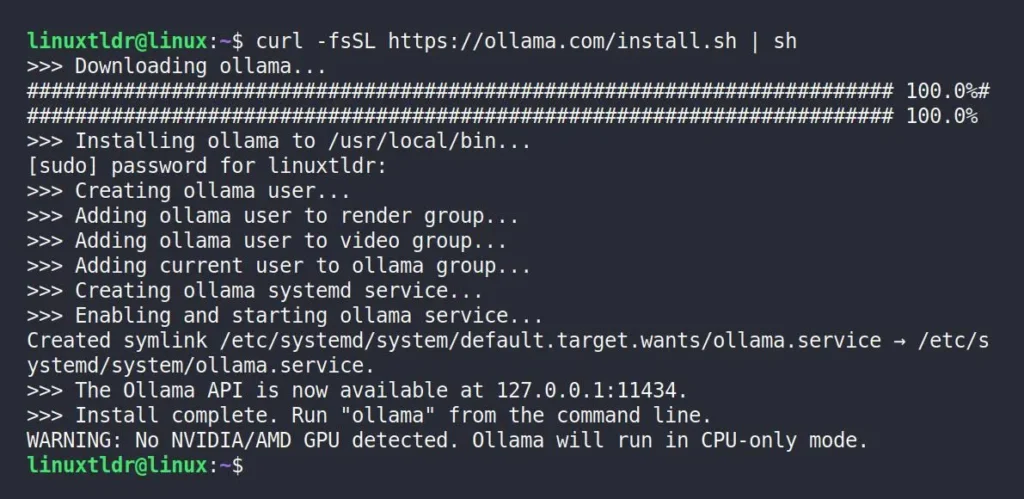

$ curl -fsSL https://ollama.com/install.sh | shYukarıdaki komut yürütüldüğünde, Ollama’nın birkaç saniye sürebilecek kurulum sürecini başlatacaktır.

Son satıra odaklanırsanız, çalışan sistemde GPU bulunmadığına dair bir uyarı görürsünüz. Gerçekten de, şu anda sistemimde harici bir GPU yok, bu yüzden tüm ağır işler zayıf CPU’m tarafından yapılacak.

2. Adım: Ollama’nın Durumunu Kontrol Edin

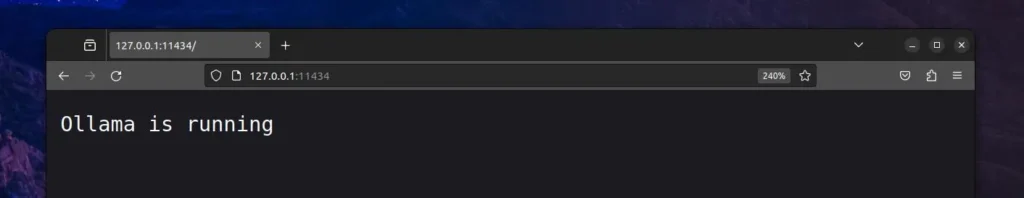

Yükleme işlemi tamamlandıktan sonra, tercih ettiğiniz tarayıcıyı (Chrome veya Firefox) açabilir ve Ollama’nın çalıştığını doğrulamak için aşağıdaki URL’ye erişebilirsiniz.

http://127.0.0.1:11434Çıktı:

Sistemimde çalışır durumda olduğunu açıkça görebilirsiniz, böylece artık favori LLM’lerimizi kurabiliriz.

Adım 3: Ollama Kullanarak LLM’leri Kurun

Artık Ollama Linux sistemimizde kurulu ve çalışır durumda olduğuna göre, tercih ettiğiniz LLM’leri keşfetmek için Ollama Kütüphanesini keşfedebilir ve bulduktan sonra aşağıdaki sözdizimini kullanarak yükleyebilirsiniz:

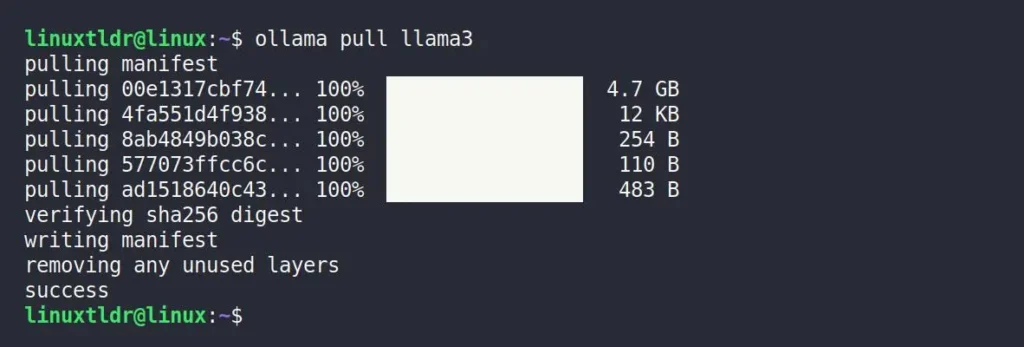

$ ollama pull <LLM_NAME>Örneğin Meta Llama 3 7B (yedi milyar) modelinin yaklaşık 4,7 GB boyutundaki son sürümünü yüklemek için aşağıdaki komutu kullanabilirsiniz:

$ ollama run llama3İndirme işlemi internet hızına bağlı olarak biraz zaman alacaktır.

Çeşitli LLM’leri deneyebileceğinizi hatırlatmak için kısa bir not. Kendinizi biraz tembel hissediyorsanız, aşağıdaki tabloya bazı popüler LLM’ler için doğrudan kurulum komutlarını ekledim.

| Model | Parameters | Size | Download |

|---|---|---|---|

| Llama 3 | 8B | 4.7GB | ollama run llama3 |

| Llama 3 | 70B | 40GB | ollama run llama3:70b |

| Phi-3 | 3.8B | 2.3GB | ollama run phi3 |

| Mistral | 7B | 4.1GB | ollama run mistral |

| Neural Chat | 7B | 4.1GB | ollama run neural-chat |

| Starling | 7B | 4.1GB | ollama run starling-lm |

| Code Llama | 7B | 3.8GB | ollama run codellama |

| Llama 2 Uncensored | 7B | 3.8GB | ollama run llama2-uncensored |

| LLaVA | 7B | 4.5GB | ollama run llava |

| Gemma | 2B | 1.4GB | ollama run gemma:2b |

| Gemma | 7B | 4.8GB | ollama run gemma:7b |

| Solar | 10.7B | 6.1GB | ollama run solar |

Adım 4: Ollama Kullanarak LLM’lere Erişin

İstenen LLM’ler yüklendikten sonra, bunlara erişmek için aşağıdaki sözdizimini kullanabilirsiniz:

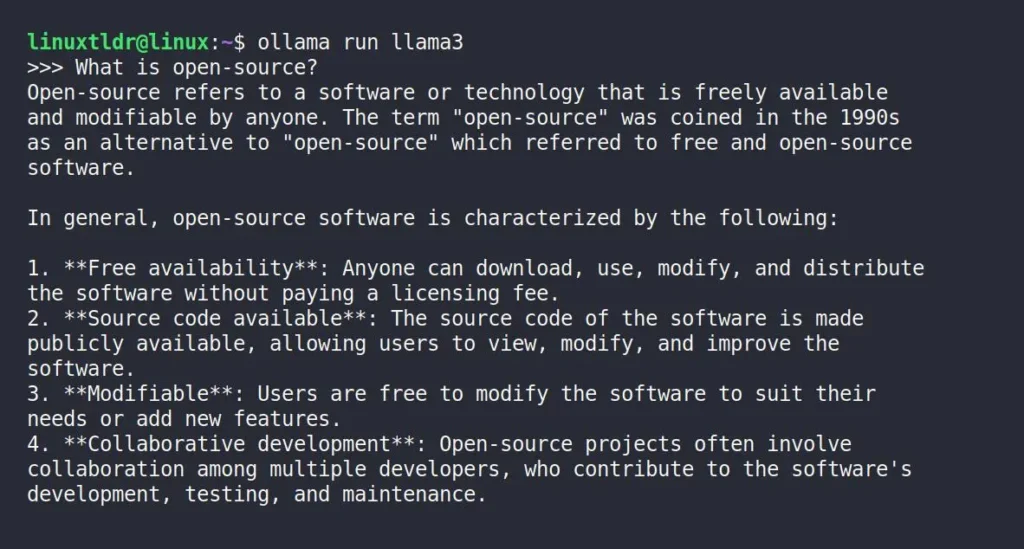

$ ollama run <LLM_NAME>Örneğin, sistemimde Meta Llama 3 yüklüyken, sohbet arayüzüne komut satırından erişmek için aşağıdaki komutu çalıştırabilirim:

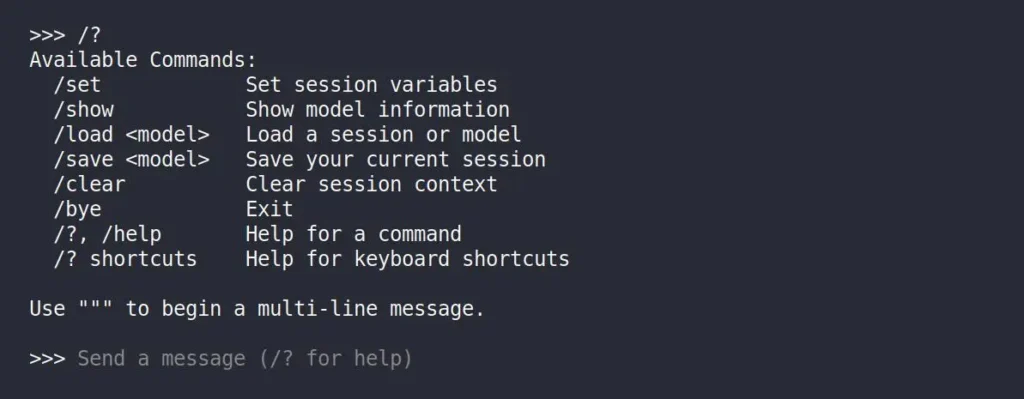

$ ollama run llama3İçeri girdiğimde tipik karşılama mesajını almadım; bunun yerine hemen “>>>” istemi belirdi. Böylece “Açık kaynak nedir?” gibi birkaç soru sormaya başladım. Yanıtını aşağıda görebilirsiniz.

Yukarıdaki statik görüntü, bu kadar çok içerik oluşturmanın ne kadar sürdüğünü açıklamıyor, ancak inanın bana, tamamen yerel sistem ve benim durumumda CPU’m tarafından işlendiği için önemli miktarda zaman aldı.

Metin oluşturma sürecine dahil olan CPU, GPU veya RAM işleme miktarını merak ediyorsanız, bazı istatistiklerini görmek için “top” veya “ps -aux” komutunu girmeniz yeterlidir.

Etkileşimi tamamladığınızda, bazı ek bilgiler almak için “Ctrl+D” tuşlarını kullanarak, “/bye” yazarak veya “/?” tuşlarını kullanarak istemden çıkabilirsiniz.

Burada Ollama’yı yüklemeyi, ardından en sevdiğiniz LLM’leri indirmeyi, çalıştırmayı ve bunlara erişmeyi öğrendiniz. Sisteminiz uzakta bulunuyorsa, tarayıcıyı kullanarak LLM’lerinize her yerden erişmek için SSH yapabilir veya Open WebUI’yi kullanabilirsiniz. Öyleyse, bunun için adımlara bakalım…

Open WebUI Kullanarak ChatGPT Benzeri Tarayıcı Arayüzü Nasıl Kullanılır

Open WebUI, ChatGPT benzeri bir arayüz aracılığıyla yerel olarak veya uzaktan tarayıcınızdan yerel olarak kurulu LLM’lerinizi kullanmanıza ve bunlara erişmenize olanak tanıyan açık kaynaklı bir projedir.

Daha kullanıcı dostudur ve yapılandırması kolaydır, bu nedenle ilgileniyorsanız, Linux sisteminize kurmak için aşağıda belirtilen adımları izleyin.

1. Adım: Docker’ı Linux’a yükleyin

Open WebUI, bir Docker konteynerini hızlı bir şekilde başlatmak için anında çekip kullanabileceğiniz bir Docker görüntüsü olarak mevcuttur, ancak önce sisteminizde Docker’ın kurulu olması gerekir.

2. Adım: Open WebUI’yi Docker’a yükleyin

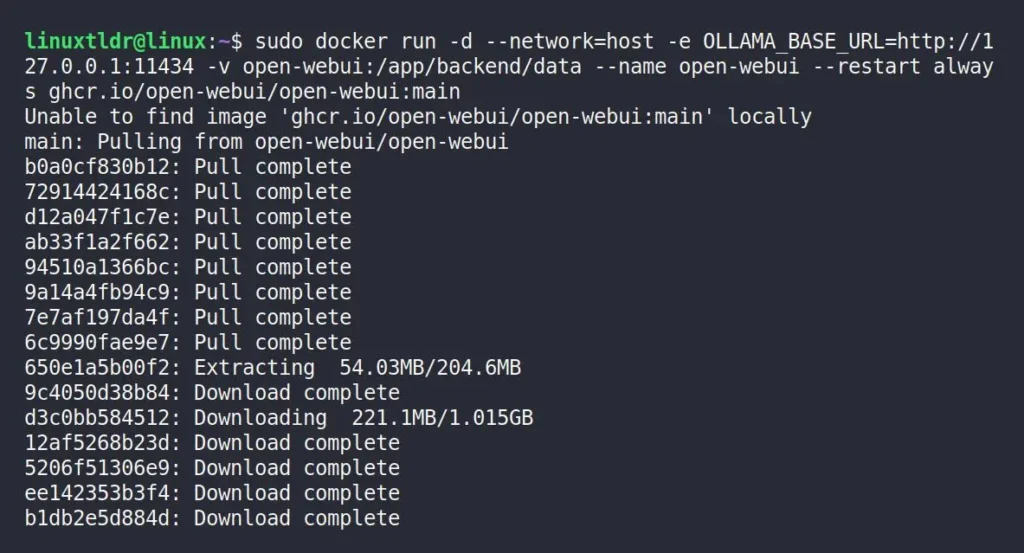

Docker sisteminize yüklendikten sonra, Open WebUI görüntüsünü çekmek için aşağıdaki komutu çalıştırabilir ve ardından indirilen görüntüyü kullanarak bir kapsayıcı başlatabilirsiniz.

$ sudo docker run -d --network=host -e OLLAMA_BASE_URL=http://127.0.0.1:11434 -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:mainYukarıdaki komutu çalıştırdığınızda, Open WebUI resim indirme işlemi internet hızınıza bağlı olarak biraz zaman alacaktır.

Çarpma kabuğu

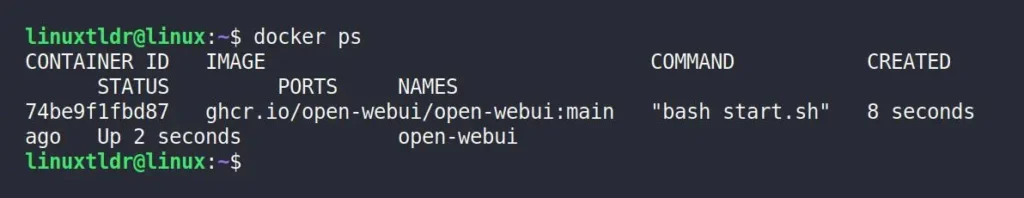

$ docker psOutput:

3. Adım: Tarayıcıda Açık WebUI’ye Erişin

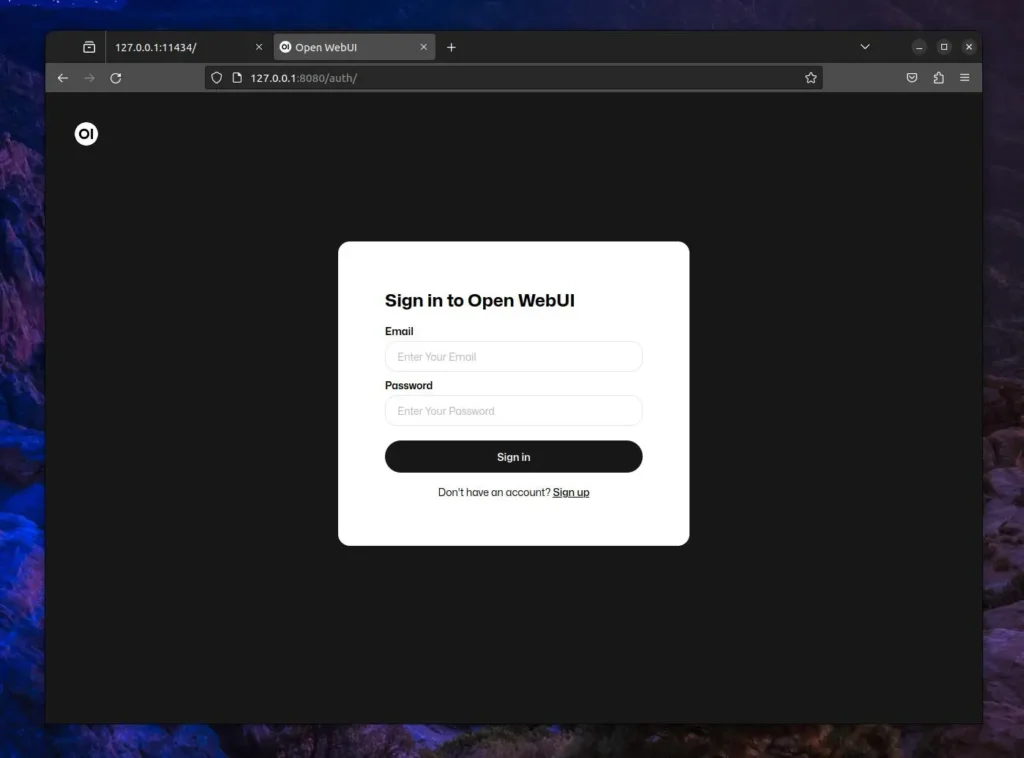

Artık Open WebUI çalıştığına göre tarayıcınızı açın ve aşağıdaki URL’ye erişin:

http://127.0.0.1:8080Bu, önce adınız, e-posta adresiniz ve şifreniz gibi ayrıntıları girerek yeni bir hesaba kaydolmanız gereken Open WebUI giriş sayfasını açacaktır. Daha sonra, oturum açmak için bu kimlik bilgilerini kullanabilirsiniz ve bunları daha sonra kullanmak üzere parola yöneticinizde güvenli bir şekilde saklamayı unutmayın.

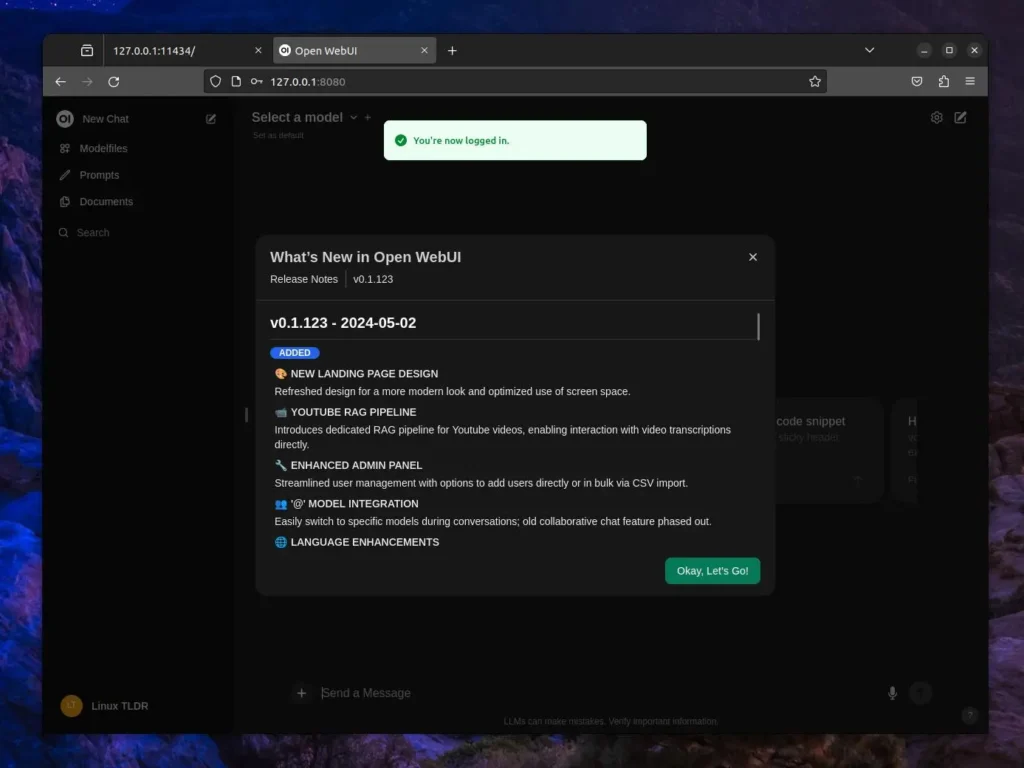

Artık kontrol panelinde Open WebUI’nin en son sürümündeki özelliklerle karşılaşacaksınız ve devam etmek için “Tamam, Hadi Gidelim!” düğmesine tıklayabilirsiniz.

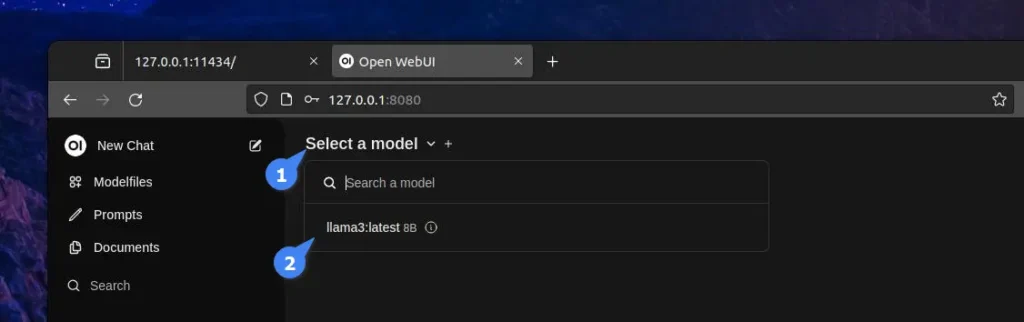

Sonunda buradasın! Sisteminizde yerel olarak yüklü LLM’lerle etkileşim kurmak için bunları sol üst köşeden seçerek başlayın. Bu makaleyi takip ediyorsanız, sisteminizde zaten “Meta Llama 3 8B modeli” kurulu olmalıdır, böylece o modeli tercih edebilirsiniz.

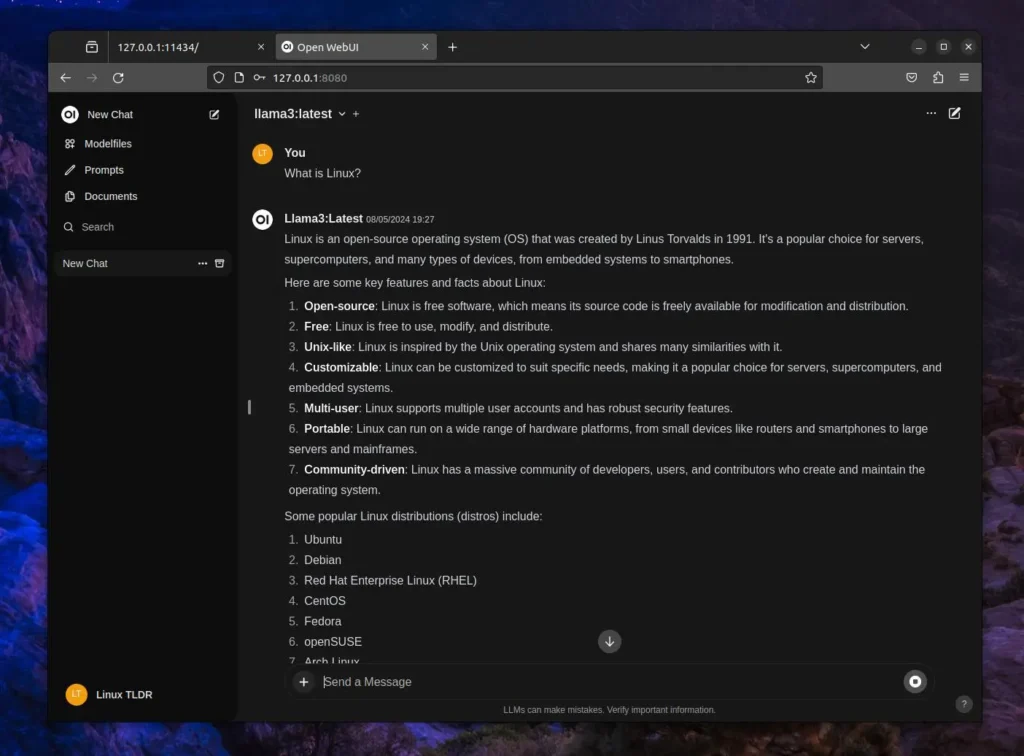

İşiniz bittiğinde, onunla etkileşime geçmeye başlayabilirsiniz.

Burada bir sohbet oluşturabilir, yeniden adlandırabilir, kaldırabilir, yanıtları düzenleyebilir ve ChatGPT arayüzünün sunduklarının ötesinde çok sayıda başka eylem gerçekleştirebilirsiniz.

Ollama Nasıl Kaldırılır ve WebUI Linux’tan Nasıl Açılır

Gereksiz bulursanız ve hem Ollama’yı hem de Open WebUI’yi sisteminizden kaldırmak istiyorsanız, terminalinizi açın ve Open WebUI kapsayıcısını durdurmak için aşağıdaki komutu çalıştırın.

$ docker stop open-webui

$ docker remove open-webuiTüm Docker görüntülerini listelemek için şunu yürütün:

$ docker imagesOpen WebUI görüntüsünü bulun ve “IMAGE ID” yi not edin, ardından aşağıdaki sözdiziminde kullanın:

$ docker rmi <IMAGE_ID>Ardından, hesabınızın ve tercihinizin Open WebUI bilgilerini içeren “/var/lib/docker/volumes/open-webui” dizinini kaldırabilirsiniz; gelecekte yüklemeyi planlıyorsanız, bunu atlayın.

Ollama’yı kaldırmak için öncelikle aşağıdaki komutu kullanarak yüklediğiniz tüm LLM’lerin listesini tanımlayın:

$ ollama listArdından adlarını kullanın ve her birini kaldırmak için aşağıdaki sözdiziminde belirtin.

$ ollama rm <LLM_NAME>Ardından Ollama hizmetini kaldırın:

$ sudo systemctl stop ollama

$ sudo systemctl disable ollama

$ sudo rm /etc/systemd/system/ollama.serviceSon olarak, Ollama ikili dosyasını “/bin” dizininden, kullanıcıdan, gruptan ve diğer şeylerden kaldırın:

$ sudo rm $(which ollama)

$ sudo rm -r /usr/share/ollama

$ sudo userdel ollama

$ sudo groupdel ollamaBu kadar,

Yazının orijinalini buradan okuyabilirsiniz.

Kariyerime 26 yıl önce başladım. Windows ve Linux sistemlerinin kurulumu, yapılandırılması, yönetimi ve bakımı dahil olmak üzere birden fazla sistem üzerinde uzmanlaştım.

Açık kaynak dünyasındaki en son gelişmelerden haberdar olmaktan ve Linux hakkındaki en son araçları, özellikleri ve hizmetleri denemekten hoşlanıyorum.

Son 6 yıldır sistem ve ağ yöneticisi olarak görev yapıyorum ayrıca Pardus Dönüşüm Projesini yönetiyorum ve Pardus İşletim Sisteminin yaygınlaşması adına uğraş gösteriyorum.

Boş zamanlarımda açık kaynaklı uygulamaların Türkçe çevirisine katılıyorum ve The Document Foundation üyesiyim.